Operare in sinergia: Visione artificiale, AI e Realtà Aumentata

Oggi, la maggior parte delle esperienze di realtà aumentata si sviluppa intorno alla sovrapposizione di informazioni note sul mondo fisico. Mappe e giochi hanno attirato molta attenzione nello spazio tecnologico dei consumatori. Nel mondo industriale, le potenzialità dell’AR che vengono sfruttate riguardano applicazioni di visualizzazione, istruzione o supporto. Alcuni esempi:

- Disponibilità di istruzioni operative virtuali per manualistica d’uso e manutenzione.

- Possibilità in fase di manutenzione di aggiungere tempestivamente nuove informazioni digitali correlate al mondo reale e al contesto del compito da svolgere.

- Il supporto a distanza consente al personale esperto di guidare il personale più giovane, con annotazioni dal vivo in loco.

Come descritto nel rapporto "The State of Industrial Augmented Reality" quelli appena citati rappresentano la grande maggioranza dei casi d'uso.

Queste esperienze AR consentono il riconoscimento di marcatori predeterminati, geometrie CAD, QRcode o codici a barre o input basati sulla posizione e altri sensori. Ma cosa succederebbe in una situazione in cui l'utente stesse guardando una macchina o una sua parte non direttamente identificabile e si trovasse senza alcun contesto su come operare o fare manutenzione?

L'intelligenza artificiale - e in particolare il deep learning - sta favorendo una nuova ondata di innovazione nelle applicazioni di computer vision (CV) e realtà aumentata (AR). La capacità di percepire ambienti – per così dire – non strutturati aumenterà le possibilità applicative della realtà aumentata e potenzierà ulteriormente i lavoratori in prima linea come mai prima accaduto.

Comprendere le differenze esistenti fra la computer vision classica e quella basata su apprendimento è fondamentale per contribuire allo sviluppo di applicazioni sia nell’immediato che nel futuro.

La Computer Vision tradizionale e le sue applicazioni

Gli ambienti industriali sono estremamente complessi e ricchi di procedure. Prendiamo ad esempio il volume dei dati scambiati dalla linea di controllo qualità motori allestita del gruppo Volvo: ogni motore richiede 40 controlli di qualità, con 200 possibili varianti di QA (quality assurance) e ciascun motore può avere fino a 4.500 diverse varianti informative (tutto ciò per un solo impianto).

Per ottenere le informazioni corrette, gli operatori della QA hanno bisogno di un digital thread completo, integrale, grazie al quale la realtà aumentata possa fornire informazioni contestualizzate in modo accurato, tempestivo e affidabile; Volvo Group, come molti altri produttori, non può permettersi downtime in un mercato ipercompetitivo come quello dell’auto.

In situazioni come questa appena descritta, in cui a fronte di una granularità è necessario disporre di un elevato livello di precisione, l’approccio tradizionale alla computer vision per implementare un'applicazione di realtà aumentata è il miglior percorso da seguire.

Si tratta di avvalersi di un algoritmo di CV del tipo ‘design-your-own’, ovvero ‘progettato in proprio', riferito a un determinato ambiente di progettazione e codifica. Un ingegnere può correlare gli input dei sensori nativi (fotocamera, GPS, accelerometro) alle geometrie 3D e consentire all'algoritmo CV di essere riconosciuto per un caso d'uso specifico. Quindi, l'ingegnere AR o il tecnico creatore di esperienze possono dare vita a questo algoritmo di CV e caso d'uso specifico in un ambiente di progettazione 3D allineando queste geometrie, punti, caratteristiche e misure per attivarlo nel proprio contesto.

Dato l’elevato grado di configurabilità ‘custom’, questo tipo di applicazioni sono comunemente impiegate laddove viene richiesta un'elevata fedeltà di identificazione degli asset. Pur con dei miglioramenti, risulta difficile misurare accuratamente la profondità nelle immagini utilizzando un approccio di deep-learning, il che rende la CV classica l'opzione migliore: essa è per natura più consona al riconoscimento di strutture 3D complesse attraverso la progettazione di algoritmi ad hoc e la scelta dei sensori.

Deep Learning: il futuro della Visione Artificiale nella Realtà Aumentata

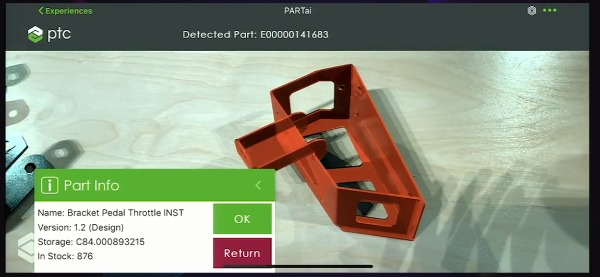

Al LiveWorx 2019, il CEO di PTC Jim Heppelman ha presentato una demo in cui l'esperienza AR ha consentito di riconoscere automaticamente un pezzo di ricambio. Il pezzo in questione non disponeva di codici a barre o marcatori target, eppure la computer vision è stata in grado di rilevare in pochi secondi la parte, il modello e la quantità in magazzino.

L'intelligenza artificiale, e più in particolare il deep learning integrato nell'applicazione di realtà aumentata, ha permesso il riconoscimento automatico dell'oggetto. Per il training delle reti neurali nel cloud la demo si è avvalsa dei dati CAD del pezzo, del quale sono stati inseriti numerosi esempi, il che ha consentito di creare un modello inferenziato di AI leggero da eseguire sull'applicazione di realtà aumentata.

John Schavemaker, direttore Computer Vision Field Lead di PTC, ha affermato: "Nella creazione di questa demo AR guidata dall'intelligenza artificiale o in qualsiasi altra applicazione AR basata sul deep-learning, il modello inferenziato ha valore solo quanto i dati di training, che in questo caso sono stati creati artificialmente dal rendering del modello CAD 3D in diverse posizioni e orientamenti, alimentando quindi la rete neurale".

L'importanza dei dati per istruire il sistema è comune in qualsiasi settore: gli algoritmi di guida autonoma dei veicoli vengono ‘addestrati’ grazie ai dati aggregati di milioni di chilometri di immagini e video di guida, mentre in medicina i modelli sono alimentati da milioni di dati raccolti dai pazienti per diagnosticare il cancro in modo più accurato e preventivo.

Applicare questo approccio mentale al mondo industriale può sortire degli impatti considerevoli. Portando l'esempio di LiveWorx in uno scenario reale, un OEM potrebbe autorizzare la sua rete di asssistenza tecnica avvalendosi della realtà aumentata integrata con l'AI. Ciò potrebbe consentire ai tecnici a riconoscere qualsiasi parte montata su una qualsiasi macchina, disponendo delle relative istruzioni per ripararla/sostituirla. Questo cambiamento potrebbe portare a un drastico miglioramento dei KPI relativamente alle operazioni di assistenza su base globale.

Anche il controllo e l’assicurazione della qualità potrebbero subire significativi miglioramenti con l'AI, utilizzando l'AR per riconoscere difetti impercettibili all'occhio umano in prodotti industriali, beni, linee di produzione ecc. Il deep learning potrebbe rendere le fabbriche più sicure, utilizzando l’AR per avvisare preventivamente i lavoratori di una possibile situazione pericolosa.

Acquisire i dati unici negli ambienti industriali

Ciò che è unico nel mondo industriale lo è per come è unico; ci sono innumerevoli oggetti, parti, prodotti, beni, macchine e processi che svolgono diverse operazioni. Scalare un'applicazione AR attraverso un approccio classico in cui un ingegnere deve scrivere ogni esperienza AR unica per ciascun oggetto nelle diverse situazioni operative, richiede tempo e denaro. Parimenti, anche il riconoscimento per immagini di ciascun singolo e unico oggetto, soprattutto se inserito in un insieme molto dettagliato (come il motore Volvo), costituirebbe un compito enorme da svolgere e soggetto a imprecisioni.

Tutto ciò rende i file CAD un filtro cruciale nell’addestramento delle reti neurali e nello scaling dell'AR in azienda.

"I dati CAD sono davvero la chiave: usando i dati CAD, si possono generare artificialmente i molti esempi visivi necessari per addestrare una rete di deep-learning, utilizzando il semplice paradigma: ad uno specifico input deve seguire l’output desiderato", afferma Schavemaker.

I dati CAD non solo includono tutti i parametri caratteristici, ma anche le annotazioni di un oggetto digitale, permettendo all'AI di riconoscerlo rapidamente nel mondo reale. Migliorare il modello inferenziato attraverso l’addestramento nel cloud, consente di ottimizzare ulteriormente il calcolo nativo sul dispositivo AR e il suo impatto sul riconoscimento. Le aziende che dispongono di questa importante fonte di dati, che consente di definire le risorse spaziando dai reparti di lavorazione ai siti remoti, detengono la chiave per sbloccare la prossima generazione di applicazioni AR supportate dall'AI.

Il futuro della Visione Artificiale

Il metodo di CV scelto dipenderà dalla specifica applicazione, ma le industrie probabilmente si avvarranno di approcci ibridi sia nei diversi scenari, così come nella stessa applicazione. Un algoritmo di deep-learning in AR sarebbe più che sufficiente per identificare un oggetto, mentre un modello classico a più alta fedeltà potrebbe tracciarlo, mapparlo e misurarlo più accuratamente. Le soluzioni AR scalabili saranno fondamentali per consentire questo necessario cambiamento di modello e ampliare l'impatto dell'AR sull'ambiente che ci circonda.

Queste innovative applicazioni AR raggiungeranno il loro pieno potenziale quando potranno avvalerso pienamente del digital thread per integrarsi con tecnologie complementari. L'IIoT fornirà telemetria in tempo reale e dati operativi dell'oggetto riconosciuto attraverso l'AR, oltre a fornire un ponte per altre informazioni rilevanti a livello di sistemi aziendali.

Nell'esempio fatto durante il LiveWorx, potrebbero essere dettagli sul service, sulle garanzie, sulle giacenze, così come informazioni sul fornitore o sulla consegna. Con questi metodi di sviluppo, l'AR costituirà la chiave d’accesso all'ecosistema industriale, fornendo il collegamento finale che consentirà ai mondi fisico e digitale di convergere.